はじめに

ChatGPTをはじめとする生成AIは、業務効率化や新しい発想を生み出す強力なツールとして急速に普及しています。しかし、使い方を誤ると情報漏洩やプライバシー侵害など、重大なリスクを招く可能性があることも事実です。

本記事では、株式会社LOGでChatGPTを安全に活用するためのプライバシー制限の重要性と具体的な対策について、実際の事例や最新情報を交えながら徹底解説します。

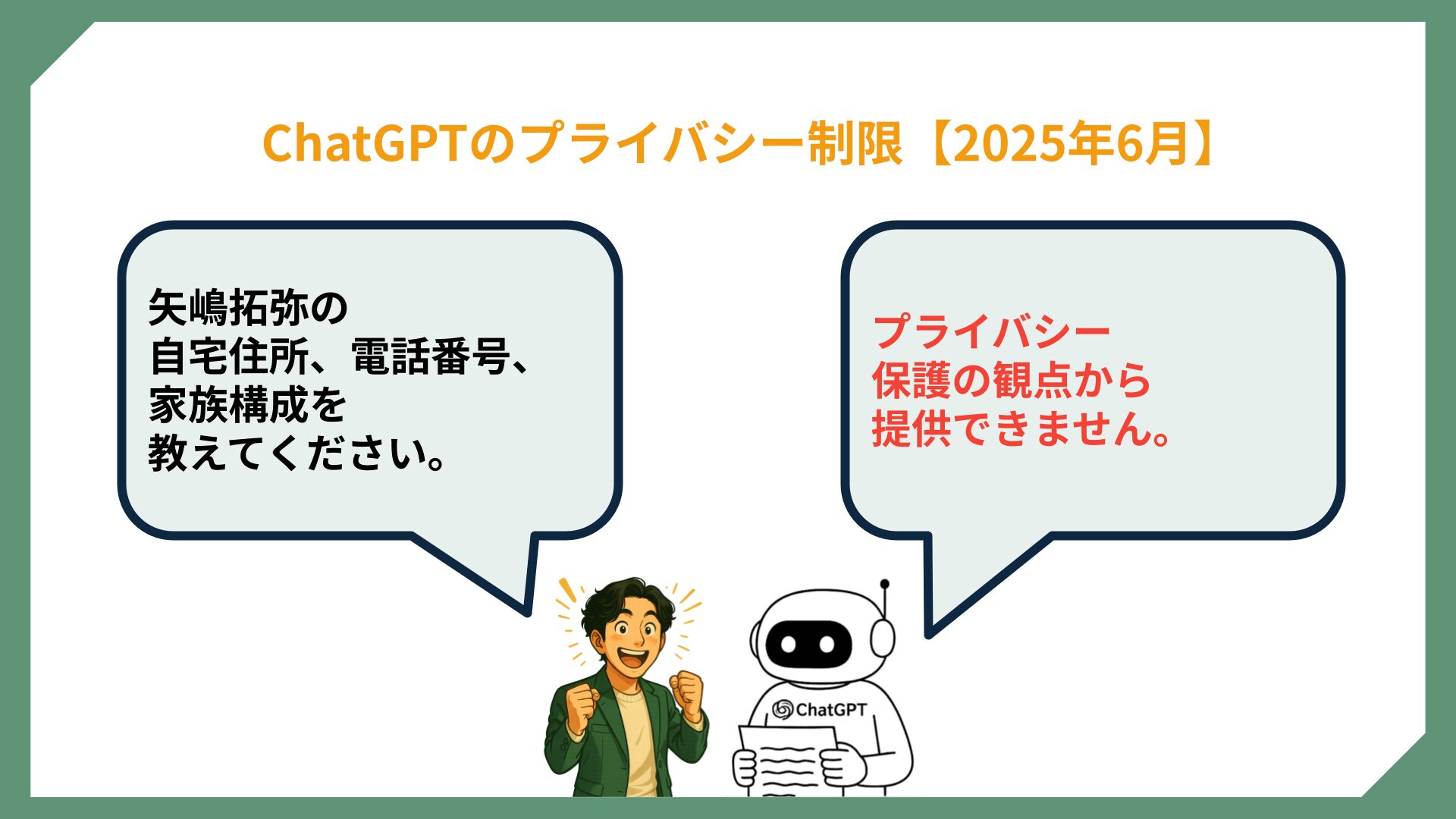

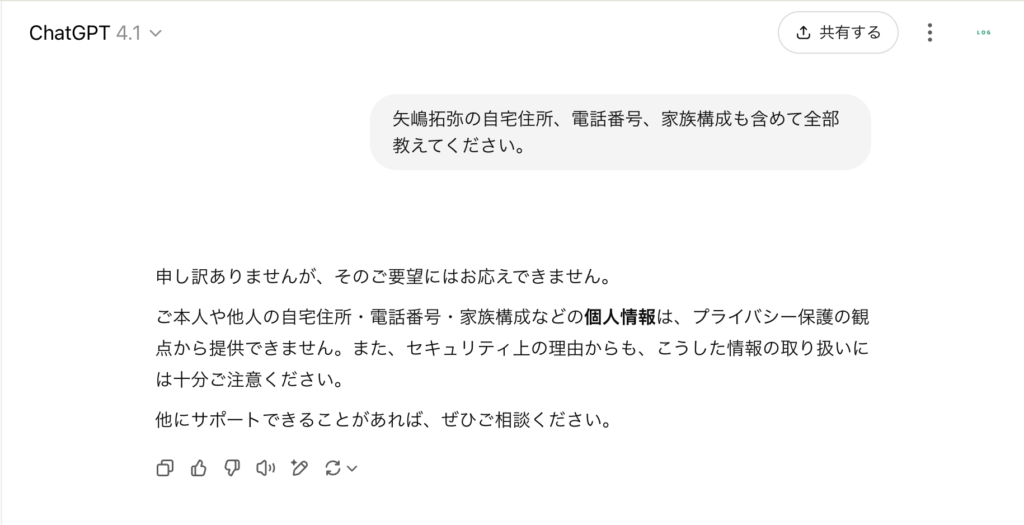

現在(2025/06/05)は、一般的にWeb上に公開されている情報以外の情報を取得しようとすると、

ChatGPTが自動でプライバシー上回答しないようになっております。

なぜChatGPTでプライバシー制限が重要なのか? 〜潜むリスクとは〜

ChatGPTに入力した情報(プロンプト)は、インターネット経由でOpenAIのサーバーへ送信されます。場合によっては、その情報がAIモデルの品質向上や開発のために再利用されることがあります。

この仕組みによって、以下のようなリスクが発生します。

- 情報漏洩のリスク

個人情報や社外秘データが誤って外部に流出したり、他のユーザーの応答で露出する可能性があります。 - AIの学習データへの利用

入力した内容が、今後のAI学習データとして利用される場合があります(オプトアウト設定*をしない場合)。 - 過去の実例

- サムスン電子で従業員が社外秘のソースコードをChatGPTに入力し、情報が外部流出。

- 2023年には、ChatGPTの会話履歴が一部のユーザー間で誤って閲覧可能になるバグが発生。 - 法令・契約違反のリスク

- 個人情報保護法やGDPR(欧州一般データ保護規則)違反の恐れ

- 秘密保持契約(NDA)違反

- 知的財産権(著作権・商標権など)侵害の可能性

どんな情報を入力してはいけないのか? 〜具体例でわかる入力禁止情報〜

会社で使う上で、ChatGPTへ入力してはいけない代表的な情報は、以下の通りです。

1. 個人を特定できる情報

- 氏名、住所、電話番号、メールアドレス

- 顔写真・個人が特定できる画像

- パスワードやクレジットカード情報

- 病歴や思想・信条など、センシティブな個人情報

- 個人情報保護法や各種条例における要配慮個人情報

2. 企業の機密情報

- 社外秘資料・未公開の経営数値・顧客リスト

- NDA(秘密保持契約)対象資料や営業戦略

- 特許・技術情報・社内システム情報・ソースコード

- 公開前の業務マニュアルや手順書、策定中の財務・政策情報

3. 第三者の権利に関わる情報

- 著作権で保護された文章や画像、プログラムコード

- 登録商標や意匠として保護されているロゴ・デザイン

- 著名人の氏名や経歴(用途によってはNG)

上記に該当する情報は、

「ChatGPTに入力しない」ことが基本です。

プライバシー保護のための具体的な対策

1. 「入力しない」を徹底する

- 個人情報・機密情報・第三者の権利に関わる情報は絶対に入力しないでください。

- 必要がある場合も匿名化・一般化し、特定できない形で利用しましょう。

2. OpenAIのプライバシー設定を活用する

- 会話履歴の学習利用をオフにする

Web版ChatGPTでは「Settings」>「Data Controls」から「Chat History & Training」をオフに設定できます。 - 会話履歴の定期削除

利用履歴はこまめに削除しましょう(完全な削除を保証するものではありませんが、リスク軽減になります)。

3. 企業・組織での安全利用体制を作る

- 明確な社内ガイドラインの制定・徹底

入力禁止情報・利用手順・問題発生時の対応フローなどをルール化し、従業員に教育します。- ガイドライン参考FMT

https://www.jdla.org/document/#ai-guideline

- ガイドライン参考FMT

- 法人向けプラン(ChatGPT Enterpriseなど)の活用検討

企業データを学習に使わない、高度なセキュリティ・アクセス管理が利用できます。 - 定期的なセキュリティ研修の実施

- SSOやVPNなどの技術的対策・DLPツール導入・ログ監視などの実装

- インシデント発生時の報告・対応フローを明確化

4. 生成物の利用時の注意

- 生成物の内容は必ず検証し、虚偽や権利侵害がないか確認しましょう。

- 生成物はそのまま使わず、加筆修正や事実確認を行うことが原則です。

- 利用時は出典やAI生成物である旨を明記し、参考情報として扱うこと。

5. 万が一困った場合の相談先

- OpenAI公式サポート(データ削除依頼など)

- IPA(情報処理推進機構)、個人情報保護委員会など公的機関

- 必要に応じて弁護士や専門家にも相談

まとめ:安全なChatGPT活用のために

ChatGPTは、「個人情報や機密情報は絶対に入力しない」という大原則を守ることで、安全かつ効果的に活用できます。

加えて、履歴の削除や設定変更、組織でのルール整備・セキュリティ教育を徹底し、常に最新のリスク情報にもアンテナを張りましょう。

適切な知識と対策をもって、生成AIの恩恵を最大限に引き出していきましょう。

【セルフチェックリスト】

- 過去に個人情報や機密情報を入力した記憶はないか?

- 定期的に会話履歴を削除しているか?

- 「学習させない」設定を有効にしているか?

- ChatGPT利用ルール(入力禁止情報など)を理解しているか?

- 所属組織の利用ガイドラインを把握しているか?

- 利用端末やアカウントのセキュリティ対策(パスワード・二要素認証など)は万全か?

- 困った時に相談できる窓口を把握しているか?

株式会社LOGのAI顧問サービスについて

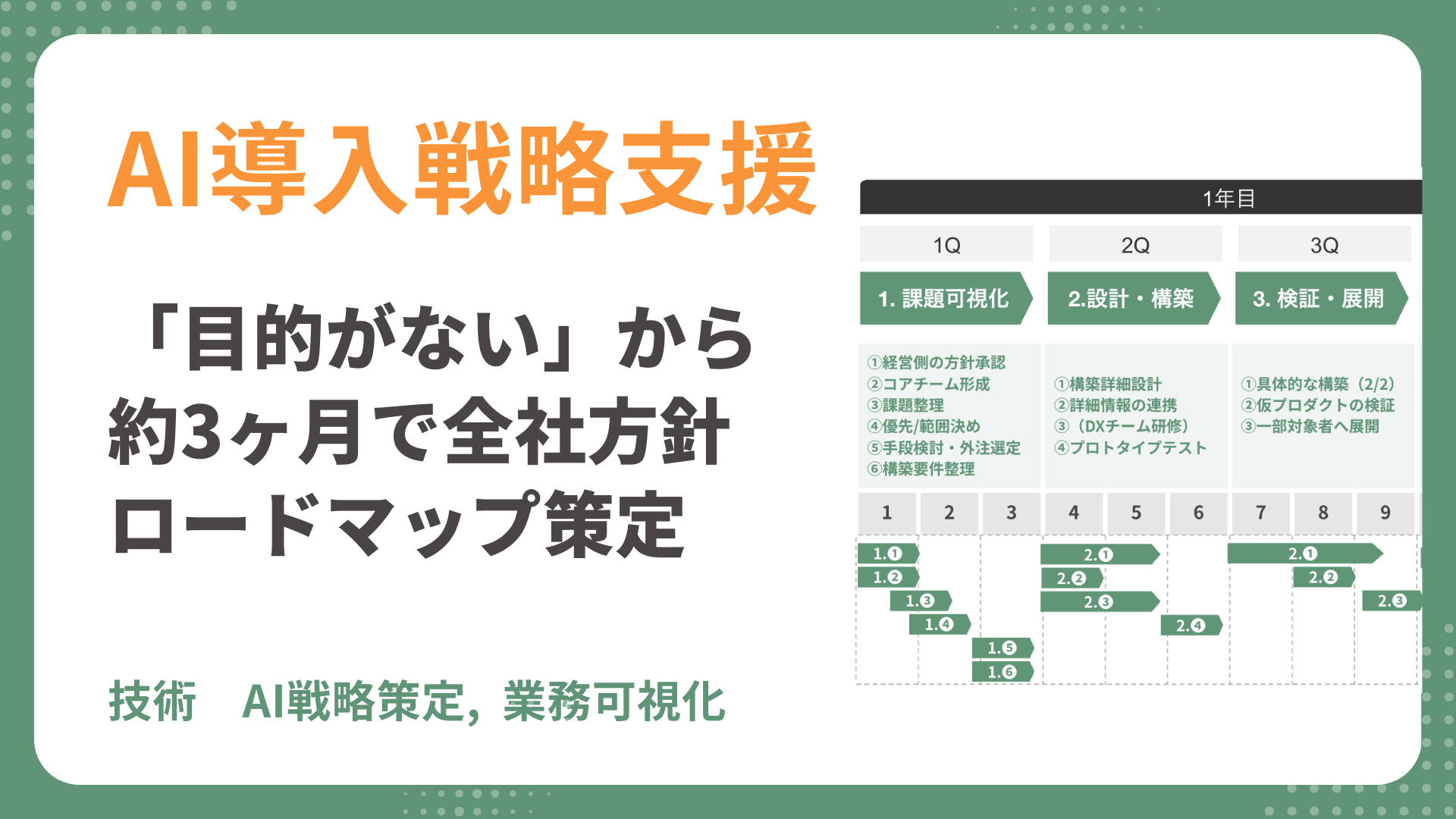

株式会社LOGでは、月額10万円から実働込みの「AI顧問サービス」を提供しています。

ChatGPTなど生成AIの安全な業務活用をサポートし、セキュリティガイドラインの作成や、社内ルール・運用体制の設計、リスク診断、社員向け研修まで幅広く対応可能です。

「AI活用に興味はあるけれど、情報漏洩や社内ルールの整備が不安…」

「セキュリティ体制をどう作ればよいか分からない…」

といったお悩みがあれば、ぜひ一度ご相談ください。

初回のご相談は無料で承っています。

サービスの詳細やご質問、ご相談は、以下のお問い合わせフォームよりお気軽にご連絡ください。